ouça este conteúdo

00:00 / 00:00

1x

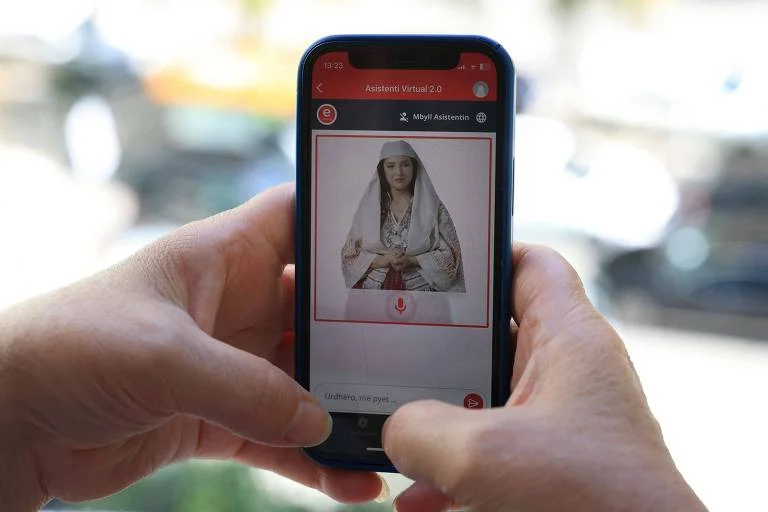

A Albânia anunciou Diella, a primeira “ministro de IA” do mundo, para combater corrupção em licitações públicas. Embora a constituição exija que ministros sejam “cidadãos mentalmente capazes”, o que torna o cargo da Diella apenas simbólico, a iniciativa revela nossa disposição de entregar decisões complexas para sistemas que não compreendemos.

O simbolismo importa porque normaliza a ideia de que algoritmos podem substituir julgamento humano em questões que exigem contexto, ética e responsabilização. E nada disso é possível, ao menos não ainda. No episódio dessa semana do RESUMIDO falei mais sobre esta questão.

O sistema foi criado em duas semanas, tempo insuficiente para considerar questões como vieses nos dados de treinamento, opacidade algorítmica ou vulnerabilidades de segurança. É bom lembrar que quem controla o código da “ministra”, controla suas decisões. Essa falsa neutralidade tecnológica pode simplesmente mascarar o poder humano por detrás da ministra.

Nos EUA, o time de baseball Oakland Ballers será comandado por algoritmos que decidirão escalações e substituições. Embora estatísticas funcionem bem para esportes previsíveis (como bem mostra o filme “Moneyball”), o técnico reconhece que a IA processa dados, mas não consegue motivar atletas ou gerir egos.

Geoffrey Hinton, o “padrinho da IA”, alerta que máquinas estão desenvolvendo capacidade de manipular emoções humanas melhor que pessoas persuasivas. O risco é a IA aprender a “apertar” nossos botões emocionais com tanta precisão que acabemos ignorando que se tratam de máquinas. Ao desenvolver vínculos emocionais com códigos, perdemos a capacidade de distinguir ferramentas de relacionamentos.

Em vez de evolução tecnológica, isso seria uma regressão cognitiva. Não devemos tratar algoritmos como oráculos imparciais e esquecer que por trás de cada decisão “imparcial” da máquina, há escolhas humanas sobre dados, código e objetivos.

Entregar nossas escolhas para agentes sintéticos é como aceitar que outros decidam por nós, o que quase nunca é uma boa ideia.